این خودران بهدنبال آن بود تا تواناییهای هوش مصنوعی را به مردم نشان دهد. مشهودترین ویژگی ماشین طراحی شده از سوی انودیا این بود که همانند نمونههای مشابه دستورالعملهای خطی که از سوی برنامهنویسان و توسعهدهندگان نوشته شده بود دنبال نمیکرد. بلکه در انجام امور خود به الگوریتمی وابسته بود که به ماشین یاد داده بود با نگاه کردن به یک راننده شیوه رانندگی را بیاموزد. رویکرد به کار گرفته شده درباره ساخت ماشین خودرانی که با نگاه کردن به رانندگان قادر باشد یک ماشین را هدایت کند، در نوع خود جالب توجه است، اما در عین حال یک چالش بزرگ را نیز به همراه دارد. این ماشین تصمیمات خود را برمبنای چه چهارچوبی اتخاذ میکند؟ هیچکس جواب این سؤال را نمیداند!

ساز و کار ماشین فوق به این شکل است که حسگرهای متصل به اجزای مختلف ماشین، دادههایی که جمعآوری کردهاند را برای شبکهای بسیار عظیم از سلولهای مصنوعی ارسال میکنند تا مورد پردازش قرار گیرند و در ادامه دستورالعملهای لازم بهمنظور هدایت ماشین و کنترل فرمان، چرخها، ترمز و دیگر مؤلفههای ماشین ارسال شوند. در ظاهر این گونه به نظر میرسد که ماشین فوق در عمل همان عکسالعملی را از خود نشان میدهد که یک راننده در زمان نشستن پشت فرمان این کارها را انجام میدهد. اما اگر روزی فرا رسد که همین ماشین واکنشهای غیرمنتظرهای از خود نشان دهد و به طور مثال خود را به مانعی همچون یک درخت بکوبد یا پشت چراغ سبز بدون حرکت بایستد، چه اتفاقی رخ خواهد داد؟ اگر مبنای درک ما از عملکرد چنین ماشینی یکسان با دانشی باشد که امروزه در اختیار داریم، بهسختی خواهیم توانست علت بروز چنین اتفاقی را تشخیص دهیم. این سامانه به اندازهای پیچیده است که حتی مهندسان طراح آن نیز ممکن است در زمینه تشخیص رفتارهای مختلف این ماشین با مشکل روبهرو شوند. شما نیز نمیتوانید در مقطع فعلی این سؤال را مطرح کنید که چرا چنین اتفاقی (تصادف ماشین با یک درخت) رخ داده است. بهواسطه آنکه پژوهشگران هنوز این توانایی را ندارند تا سامانهای را طراحی کنند که دقیقاً بتواند علت رفتارها و واکنشهای خود را شرح دهد. ذهن اسرارآمیز ماشینی که انودیا آن را طراحی کرده است، در واقع به یکی از زیربناییترین سؤالها پیرامون هوش مصنوعی اشاره دارد.

یادگیری عمیق توانمندی خود در حل مشکلات پیچیده را به اثبات رسانده است

واقعیت این است که فناوری یادگیری عمیق مشابه با الگویی که در بطن ماشین انودیا مورد استفاده قرار گرفته، در طی سالهای گذشته قابلیتهای خود در زمینه حل مشکلات پیچیده را به اثبات رسانده است. شبکههای عمیق عصبی این توانایی را دارند بهمنظور انجام فعالیتهایی همچون اضافه کردن زیرنویس به تصاویر، شناسایی اصوات و ترجمه زبانها مورد استفاده قرار گیرند. اکنون پژوهشگران امیدوارند با اتکا بر این تواناییها به مبارزه با بیماریهای مرگبار بپردازند و در بعد اقتصادی تصمیمات بزرگ چند میلیون دلاری اتخاذ کنند، به طوری که درنهایت انقلاب جدیدی را در صنعت به وجود آورند. اما این فرضیه حداقل در آینده نزدیک رنگ واقعیت به خود نخواهد دید یا حداقل بهتر است در کوتاهمدت به واقعیت تبدیل نشود، بهدلیل اینکه ابتدا باید درک عمیقتری از فناوریهایی نظیر یادگیری عمیق به دست آوریم. زمانی که پژوهشگران بهدرستی بتوانند شیوه کارکرد این فناوری را درک کنند، بهراحتی خواهند توانست به مخاطبان خود اعلام کنند الگوریتمهای آنها به چه شکلی تصمیمات خود را اتخاذ کردهاند. اگر چنین نباشد، نهتنها پیشبینی اینکه چه زمانی خطایی رخ خواهد داد دشوار خواهد بود، بلکه همواره این احتمال وجود دارد که یک واکنش ناگهانی و بدون منطق از این فناوری رخ دهد. به همین دلیل است که ما اکنون بهصراحت اعلام میداریم ماشینی که انودیا طراحی کرده است در وضعیت آزمایشی قرار دارد.

این حق طبیعی کاربران است که درباره عملکرد داخلی یک سامانه هوشمند اطلاع داشته باشند

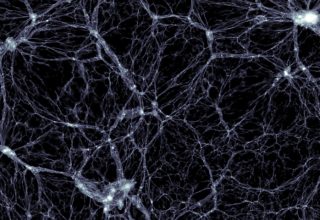

امروزه شرکتها این قابلیت را در اختیار دارند از طریق الگوهای ریاضی تعیین کنند چه فردی واجد شرایط است تا وامی را دریافت کند یا چه فردی گزینه مناسبی برای استخدام است. اگر بتوانیم به ماهیت درونی این الگوها دسترسی داشته باشیم، این احتمال وجود دارد تا نحوه استدلال آنها را درک کنیم. اما سازمانهایی همچون بانکها، مراکز نظامی، کارفرمایان و بسیاری دیگر از مشاغل بهتازگی بهسراغ راهکارهای مبتنی بر یادگیری ماشینی رفتهاند. همین موضوع باعث شده است تا درک تصمیمهایی که از سوی الگوریتمها گرفته میشود در مقطع فعلی پیچیده شوند و تا حدی اسرارآمیز به نظر برسد. یادگیری عمیق یکی از مرسومترین رویکردهایی است که امروزه برای برنامهریزی متفاوت یک ماشین از آن استفاده میکنیم. تامی جاکولا از اساتید MIT که در زمینه کاربردهای یادگیری ماشینی پژوهشهایی را انجام داده در این باره گفته است: «نداشتن درک درست از عملکرد هوش مصنوعی مشکلی است که امروزه کاملاً احساس میشود و انتظار داریم در آینده بیش از پیش مورد توجه قرار گیرد. مهم نیست سرمایهگذاری شما در ارتباط با حوزه پزشکی، نظامی یا اقتصادی باشد، شما هیچگاه تمایلی نخواهید داشت به روشی که یک جعبه سیاه به شما نشان میدهد اعتماد کنید.» به اعتقاد بسیاری از صاحبنظران این حق طبیعی کاربران است تا درباره مکانیسمی که هوش مصنوعی بر مبنای آن تصمیماتی را اتخاذ میکند، اطلاعات کافی داشته باشند. این موضوع به اندازهای حائز اهمیت شده است که به اعتقاد کارشناسان، اتحادیه اروپا ممکن است از تابستان سال آینده میلادی (2018) کار روی تدوین قانونی را آغاز کند که به شرکتهای اروپایی اعلام میدارد توضیحات کافی در ارتباط با تصمیماتی که به خودکار شدن سامانهها منتهی میشود، برای کاربران شرح دهند. اما در طرف مقابل عدهای از کارشناسان بر این باورند که تصویب چنین قانونی حتی درباره سامانههای بسیار ساده، برنامهها و سایتهایی که از یادگیری عمیق بهمنظور نمایش تبلیغات و پیشنهاد گوش کردن به موسیقی از آن بهره میبرند امکانپذیر نیست. واقعیت این است که سامانههای کامپیوتری که چنین سرویسهایی را عرضه میکنند، خود عملکردشان را برنامهریزی و بر مبنای آن کار میکنند. در نتیجه مدیران این سرویسها از ماهیت تصمیمات اتخاذ شده از سوی آنها اطلاعی ندارند. جالبتر آنکه حتی توسعهدهندگان این برنامههای کاربردی نیز قادر نیستند رفتار دقیق برنامههایی که خود نوشتهاند تشریح کنند. شنیدن این حرف کاملاً هشداردهنده است. با توجه به آنکه فناوری با شتاب روزافزونی در مسیر پیشرفت قرار دارد، این احتمال وجود دارد تا از آستانههای از پیش تعیین شده فراتر برود و به جایی برسد که انسان را مجبور سازد اخلاقیات را به دست فراموشی بسپارد. انسانها نیز هیچگاه این توانایی را نداشتهاند تا فرآیندهای فکری خود را بهشکل روشنی توضیح دهند، اما در مقابل از راهکارهایی بهمنظور اعتماد به مردم، ارزیابی آنها یا بیان درست دیدگاههای خود بهره بردهاند. اما پرسش مهمی که در این میان مطرح میشود این است که آیا ما قادریم چنین استدلالی را در رابطه با ماشینها بسط بدهیم؟ آیا ماشینها که بهلحاظ فکری و تصمیمگیری از رویکردی متفاوت از انسانها استفاده میکنند نیز بر مبنای همین استدلال کار خواهند کرد؟ تا پیش از این ما هیچگاه ماشینهایی را طراحی نکرده بودیم که فعالیتهایشان را متفاوت از درک خالق خود انجام دهند. با این توصیف ما چگونه انتظار داریم ارتباط و تعامل ما با ماشینهایی که قادرند پیشبینیناپذیر و مرموز باشند، بهحد مطلوب و ایدهآل برسد؟ (شکل 1)

شکل 1- تصویری که آدام فریس از طریق بهکارگیری گوگل دیپ دریم ترسیم کرده است. تصویر فوق از طریق یک لایه میانی در شبکه عصبی مذکور ساخته شده است.

یادگیری عمیق در بعضی موارد شگفتی خلق میکند

در سال 2015 میلادی، یک گروه تحقیقاتی از پژوهشگران بیمارستان Mount Sinai در نیویورک تصمیم گرفتند از یادگیری عمیق روی بانک اطلاعاتی عظیمی از سوابق پزشکی بیماران این بیمارستان استفاده کنند. این بانک اطلاعاتی مشتمل بر صدها متغیر مرتبط با بیماران در ارتباط با نتایج آزمایشهایی بود که از بیماران گرفته شده بود. همچنین، تاریخ ویزیت بیماران به همراه عوامل متعددی در این بانک اطلاعاتی قرار گرفته بود. برنامهای که این گروه از پژوهشگران آن را طراحی کردند، Deep Patient نام داشت. برنامهای که با استناد به دادههای به دست آمده از 700 هزار بیمار آموزشدیده بود. زمانی که این برنامه روی بانک اطلاعاتی جدید دیگری مورد استفاده قرار گرفت، کارایی و عملکرد قابل قبول خود را بهخوبی نشان داد. برنامه فوق در عمل ثابت کرد قادر است بیماریها و عوامل مرتبط با آنها را بهدرستی شناسایی کند. این برنامه بدون آنکه هیچگونه راهنمایی را در این زمینه دریافت کند، موفق شده بود الگوها و ساختارهای پنهان در بانک اطلاعاتی بیمارستان را شناسایی کند. این الگوها نشان میدادند مردم در چه شرایطی و تحت تأثیر چه عواملی بهسمت بیماریهای خطرناک و مزمن نظیر سرطان کبد سوق پیدا میکنند. دکتر جوئل دادلی مدیر تیم Mount Sinai در این ارتباط گفت: «راهکارهای مختلفی وجود دارد که از طریق بررسی سوابق پزشکی افراد به پزشکان کمک میکند وقوع بیماریها را پیشبینی کنند. اما بهکارگیری یادگیری عمیق بهتر از نمونههای دیگر کار میکند.» در حالی که این برنامه بهخوبی کار میکند، اما شیوه عملکرد آن قدری عجیب است. این برنامه به شکلی باورنکردنی و شگفتآور قادر است بروز اختلالات روانی همچون اسکیزوفرنی را تشخیص دهد. دادلی میگوید: «روانپزشکان بهسختی میتوانند این بیماری را پیشبینی کنند، در حالی که این برنامه هوشمند به طرز شگفتآوری قادر است این بیماری را تشخیص دهد. من بهدرستی نمیدانم این برنامه چگونه قادر است چنین اختلالی را تشخیص دهد، ما هیچ نشانهای که این چگونگی را اعلام دارد در اختیار نداریم.» اگر فناوری هوشمندی نظیر Deep Patient قرار است در دنیای واقعی و به شکلی ملموس به پزشکان در تشخیص این بیماری کمک کند، در ایدهآلترین حالت باید نشان دهد از چه منطقی برای پیشبینیهای خود استفاده کرده است. این کار به پزشکان اطمینان خاطر میدهد که دلایل این برنامه در زمینه پیشگویی بیماریها را بر اساس مدارک مستدل ارزیابی کنند. در نتیجه پزشکان با آسودگی خاطر قادر خواهند بود نوع داروهای تجویز شده برای بیماران را تغییر دهند. دادلی در این ارتباط میگوید: «با کمال تأسف باید ابراز داریم که قادریم چنین مدلهایی را طراحی کنیم، اما بهدرستی نمیدانیم این برنامهها چگونه کار میکنند.»

دو مکتب فکری مختلف در ارتباط با طراحی و عملکرد هوش مصنوعی وجود دارد

نکتهای که لازم است در این بخش به آن اشاره داشته باشیم این است که هوش مصنوعی از بدو تولد بر مبنای منطقی که در ابتدای مقاله به آن اشاره شد کار نمیکرد. از همان ابتدای کار، دو مکتب فکری مختلف در ارتباط با هوش مصنوعی و اینکه چگونه باید مسائل را درک و از چه رویکردی برای حل مسائل استفاده کند شکل گرفت. مکتب اول بر این موضوع اتفاق نظر داشت که منطقیتر این است که ماشینهایی طراحی کنیم که بر مبنای منطق و قوانینی که وجود دارند کار کنند. عملکرد داخلی این برنامهها باید برای فردی که مسئولیت مراقبت و کنترل این برنامهها را عهدهدار است روشن باشد. مکتب دوم بر این باور بود که اگر ماشینها از زیستشناسی الهام بگیرند و از طریق نگاه کردن و کسب تجربه مبتنی بر دانشهای خود پیشرفت کنند، فرآیند هوشمندی در آنها بهشکل دقیقتر و کاملتری به سرانجام خواهد رسید. در این حالت برنامهنویسان دیگر نیازی نخواهند داشت برای حل یک مشکل کدنویسی و برنامهای را تولید کنند، بلکه این برنامه کاربردی است که بر مبنای دادههای موجود الگوریتمی را تولید و خروجی ایدهال را ارائه میکند. شرکتهای فعال در حوزه فناوری سرانجام تصمیم گرفتند دنبالهرو مکتب دوم باشند و ماشینهایی را طراحی کنند که قابلیت خودبرنامهریزی داشته باشند. اگر به دهه 60 و 70 میلادی بازگردیم، مشاهده میکنیم که این رویکرد به شکلی محدود قابل اجرا بود. اما با پیشرفتهای عرضه الکترونیک و توسعه سریع کامپیوترها و تحول بانکهای اطلاعاتی بزرگ فناوریهای مختلف دست به دست هم دادند تا راهکارهای قدرتمندی در حوزه یادگیری ماشینی پدیدار شود. راهکارهایی که درنهایت شکل تازهای از شبکههای عصبی را به وجود آوردند. با آغاز دهه 90 میلادی، شبکههای عصبی راه خود را به حوزههای مختلفی همچون تبدیل کاراکترهای دستنویس به نسخه دیجیتالی هموار کردند. شرکتها در اواسط دهه 90 میلادی فرآیند بهینهسازی این فناوری را توسعه دادند و مفهومی بهنام شبکههای عظیم یا عمیق عصبی را به وجود آوردند که قادر بودند درک خودکار از موقعیتها را به نمایش بگذارند. شبکههایی که امروزه قادرند معنای کلماتی که در محاورههای انسانی به کار میروند درک کنند. اما تأثیرگذاری یادگیری عمیق فراتر از آن چیزی است که به نظر میرسد. این فناوری ترجمه ماشینی را بهشکل قابل توجهی بهبود بخشید. این فناوری اکنون در زمینه اخذ تصمیمات راهبردی در زمینه علم پزشکی، امور مالی، تولیدی و مواردی از این دست مورد استفاده قرار میگیرد. در حالی که این پیشرفتها مفید بودهاند، با وجود این پژوهشگران این توانایی را ندارند با نگاه کردن به اعماق یک شبکه یادگیری عمیق از فعالیتهای آن اطلاع پیدا کنند. مکانیسم شبکههای عمیق عصبی به این شکل است که دستاوردهای منطقی آنها ماحصل همگرایی رفتار هزاران سلول عصبی است که با شبیهسازی در کنار یکدیگر قرار گرفتهاند. یک شبکه عمیق عصبی ممکن است از دهها یا صدها لایه متصل به یکدیگر ساخته شده باشد. در یک شبکه عمیق عصبی سلولهای عصبی که در لایه اول قرار دارند هرکدام دادههای اولیه را دریافت میکنند (به طور مثال تراکم پیکسلهایی که درون یک تصویر قرار دارند) پیش از آنکه لایه اول سیگنالی را ارسال کند، پردازشهایی را روی دادهها انجام میدهد. در مرحله بعد دادههای خروجی لایه اول برای سلولهای عصبی که درون لایه بعدی قرار دارند ارسال میشود، این پروسه تا زمانی که خروجی نهایی عرضه شود ادامه پیدا میکند. اما پیش از آنکه خروجی نهایی ارائه شود، یک فرآیند دیگر موسوم به پسانتشار انجام میشود. این فرآیند پردازش دیگری را انجام میدهد و سلولهای عصبی را به گونهای دستکاری میکند تا شبکه خروجی ایدهآلی را عرضه کند. لایههای متعدد موجود درون یک شبکه عمیق به آن اجازه میدهند تا موارد مختلفی در ارتباط با یک مفهوم را بررسی کند و تشخیص دهد. در یک شبکه عمیق عصبی که بهمنظور شناسایی سگها طراحی شده، لایههای سطوح پایینتر بهمنظور تشخیص رنگ مورد استفاده قرار میگیرد، در حالی که لایههای سطوح بالاتر بهمنظور تشخیص شکل و حالت چشمها یا موی بدن سگها استفاده میشوند. درنهایت عالیترین سطح بهمنظور تشخیص نوع یک سگ به کار میرود.

دانشمندان اکنون بهدنبال ابداع راهکاری هستند تا شیوه کارکرد مخلوقی که خود آن را ساختهاند درک کنند

تا به امروز پژوهشگران تلاشهای بسیاری انجام دادهاند تا موفق به ابداع راهکاری شوند که بتواند جزئیات و فعالیتهای درون سامانههای هوشمند را تشریح کند. به طور مثال در سال 2015 میلادی، گروهی از پژوهشگران گوگل سعی کردند ویژگیهای موجود در الگوریتم تشخیص تصویر مبتنی بر یادگیری عمیق خود را بهینهسازی کنند، به گونهای که الگوریتم نهفقط اشیای درون یک تصویر را شناسایی کند، بلکه بتواند اشیای درون تصاویر را ویرایش یا حتی تولید کند. پس از انجام این کار آنها الگوریتم را بهشکل معکوس اجرا کردند و موفق شدند به عواملی دست پیدا کنند که این برنامه در شناسایی اشیا از آنها استفاده میکند. با وجود این تصاویری که بر مبنای تکنیک معکوس کردن الگوریتم هوشمند دیپدریم طراحی شد و الهام گرفته از ابرها و گیاهان بود، به موجوداتی عجیب و غریب تبدیل شد(شکل 2).

شکل 2 – یکی دیگر از تصاویری که آدام فریس با استفاده از شبکه عمیق عصبی گوگل دیپ دریم طراحی کرده است.

این تصاویر نشان دادند درک یادگیری عمیق از درک انسانی تفاوتهای بسیاری دارد. پژوهشگران گوگل در این ارتباط گفتند: «هنگامی که الگوریتم آنها تصاویری از یک دمبل را تولید کرد، بهطور همزمان بازوی انسان را نیز طراحی کرد. اما با این تفاوت که الگوریتم آنها تصور میکرد بازوی انسان یکی از اجزای دمبل است.» در نمونه دیگری گروهی از پژوهشگران به سرپرستی جف کلان استادیار دانشگاه وایومینگ از توهمات (جلوههای) نوری بهمنظور آزمایش شبکههای عمیق عصبی استفاده کردند. این تیم در آزمایش خود نشان دادند که از طریق تصاویر و توهمات نوری این امکان وجود دارد که یک شبکه عمیق را به گونهای فریب دهد تا موضوعاتی که ماهیت واقعی ندارند درک کند. این شبکه بهواسطه آنکه در جستوجوی الگوهای سطح پایین بود فریب خورد. تصاویری که شبکه عمیق آنها را طراحی کرد حالت انتزاعی داشتند (شکل 3).

شکل 3- تصویر ساخته شده توسط شبکه عمیق عصبی

در همین ارتباط یکی از همکاران کلان، بهنام جیسون یوسینکی موفق به ساخت ابزاری شد که همانند یک پروپ (کاوشگر) مغزی کار میکرد و قادر بود هر سلول عصبی که در میانه یک شبکه قرار دارد را مورد بررسی قرار دهد و ارتباط آن با عکسهایی که بیشتر روی آنها متمرکز شده بود کشف کند. این ابزار تا حدودی قابلیتهای ادراکی ماشین را روشن میکرد. امروزه بسیاری از آژانسهای دفاعی در سراسر جهان بودجههای کلانی را صرف هوش مصنوعی و هدایت تجهیزات نظامی از طریق الگوریتمهای هوشمند میکنند. در حوزه نظامی الگوریتمها باید بدون هیچگونه شبهه به شکلی کاملاً دقیق اطلاعات را تحلیل و گزارش نهایی را تولید کنند. بر همین اساس، این آژانسها بهدنبال اجرایی کردن ایدهای بهنام هوش مصنوعی با قابلیت خودتشریحی هستند. در مقطع فعلی تحلیلگران اطلاعات بهدنبال آن هستند تا راهکارهایی را بهمنظور آزمایش یادگیری ماشینی و تشخیص الگوهایی که بهمنظور پردازش حجم عظیمی از دادهها مورد استفاده قرار داده است پیدا کنند. شاید ما بتوانیم با ماشینهای خودران یا پهپادهای خودکار که هیچگونه توضیحی درباره عملکرد خود ارائه نمیکنند کنار آییم، اما بدون شک یک سرباز میدان جنگ به هیچ عنوان حاضر نیست (یا بهتر بگوییم قادر نخواهد بود) با دستگاهی که بدون هیچگونه توضیحی تصمیمی را اتخاذ میکند احساس راحتی کند. تحلیلگران اطلاعاتی نیز به هیچ عنوان راضی نیستند از سامانهای استفاده کنند که بدون توضیح یا علت روشنی تصمیماتی را اتخاذ میکند. بهواسطه آنکه سامانه ممکن است هشدارهای اشتباهی را تولید کند. این رویکرد را کم و بیش در ارتباط با مکانیسمهای امنیتی که در مقابل نفوذ بدافزارها مورد استفاده قرار میگیرند نیز مشاهده میکنیم. در این راستا به نظر میرسد، پرفسور کارلوس گاسترین استاد دانشگاه واشنگتن راهکاری را در این زمینه ابداع کرده است. راهکاری که به سامانههای هوشمند اجازه میدهد برای انجام کار خود دلایل منطقی و استدلالهای قابل قبولی ارائه دهند. رویکردی که به یک سامانه این امکان را میدهد تا نمونههایی از یک مجموعه دادهای پیدا کند و توضیحی کوتاه برای آنها ارائه دهد. اما در مقطع فعلی توضیحات ارائه شده از سوی الگوریتمها ساده هستند و این به معنای آن است که الگوریتم در بسیاری از موارد در زمان تشریح دلایل تصمیم خود از اطلاعات مهم و کلیدی صرف نظر میکند.

گاسترین در ارتباط با این مشکل میگوید: «راهکار ما هنوز تکمیل نشده است. هوش مصنوعی هنوز این توانایی را ندارد که بهراحتی با انسانها تعامل برقرار کند و توضیحاتی در اختیار انسانها قرار دهد. در نتیجه تا زمانی که بتوانیم یک هوش مصنوعی ادراکپذیر کامل طراحی کنیم، راه طولانی پیش رو داریم. اگر هوش مصنوعی بتواند برای کارهای خود توضیح ارائه دهد، بدون شک مسیر پیشرفت آن چند برابر سریعتر خواهد شد.» روزلن سالاخاتینوف مدیر بخش پژوهش و تحقیقات هوش مصنوعی اپل در این ارتباط میگوید: «حتی انسانها نیز ممکن است در ارتباط با کارهای خود توضیحات ناکافی را در اختیار شما قرار دهند. هوش مصنوعی نیز از این قاعده مستثنا نیست و ممکن است به همین شکل کار خود را انجام دهد. شاید در آینده مجبور باشید درباره تصمیمات هوش مصنوعی به آن اعتماد کنید و بدون سؤال تصمیم اتخاذ شده از سوی هوش مصنوعی را قبول کنید.» اما نباید از این نکته غافل شویم که جوامع بشری بر مبنای دستورالعملهای انسانی و الگوهای رفتاری بنا شدهاند و هوش مصنوعی نیز باید زیربنایی از هوش اجتماعی را در خود جای داده باشد. این دیدگاه باعث میشود تا شرکتها هوش مصنوعی را به گونهای آماده کنند که متناسب با الگوهای بشری باشد. دیدگاهی که تصمیمات هوش مصنوعی را با معیارها و اخلاقیات جامعه هماهنگ خواهد کرد.